XML Sitemaps a Escala: Construir, Dividir y Validar Sin Errores Silenciosos

Un sitemap es la forma más educada de decirle a un motor de búsqueda qué quiere que se rastree. A diferencia de robots.txt, que es exclusión, un sitemap es una señal positiva. Dice, en formato legible por máquina, aquí están las URLs que importan en este sitio, por favor venga a verlas.

La mayoría de los sitemaps se desincronizan silenciosamente del resto del sitio. Las páginas se marcan como noindex, las redirecciones se acumulan, los slugs cambian, y el sitemap sigue listando las URLs antiguas. Para cuando alguien lo nota, el archivo lista miles de URLs que ya no existen o que ya no quieren estar en el índice. Esta guía cubre la especificación del sitemap XML, las reglas de división a escala, qué pertenece al archivo y qué no, las variantes especializadas, la validación y los errores comunes que rompen el archivo en silencio sin generar una sola advertencia.

Qué es realmente un sitemap XML

El sitemap XML es un archivo público en la raíz de su dominio, servido como XML, que lista las URLs que quiere que un crawler considere. El formato lo define la especificación abierta sitemaps.org, redactada originalmente en 2005 por Google, Yahoo y Microsoft, y hoy seguida por todos los grandes motores de búsqueda y crawlers de IA.

Un sitemap mínimo válido se ve así:

<?xml version="1.0" encoding="UTF-8"?>

<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<url>

<loc>https://example.com/</loc>

<lastmod>2026-04-20</lastmod>

</url>

<url>

<loc>https://example.com/blog/articulo</loc>

<lastmod>2026-04-22</lastmod>

</url>

</urlset>Cada entrada <url> tiene un campo obligatorio, <loc>, que es la URL absoluta de la página. Se permiten tres campos opcionales: <lastmod> para la fecha de última modificación, <changefreq> como sugerencia de frecuencia de actualización, y <priority> como peso relativo de 0,0 a 1,0.

Una nota sobre los campos opcionales. Google ha declarado públicamente que ignora <priority> y <changefreq> por completo, y solo presta atención laxa a <lastmod>. Bing y Yandex los usan algo más, pero la recomendación práctica es mantener <lastmod> con precisión y prescindir de los otros dos. Un lastmod correcto es una pista valiosa, uno engañoso es un riesgo.

Los sitemaps deben estar codificados en UTF 8. Las URLs dentro de <loc> deben escapar las cinco entidades XML especiales (&, ', ", <, >). El error silencioso más común es un ampersand sin escapar dentro de una query string, que deja todo el sitemap sin poder analizarse.

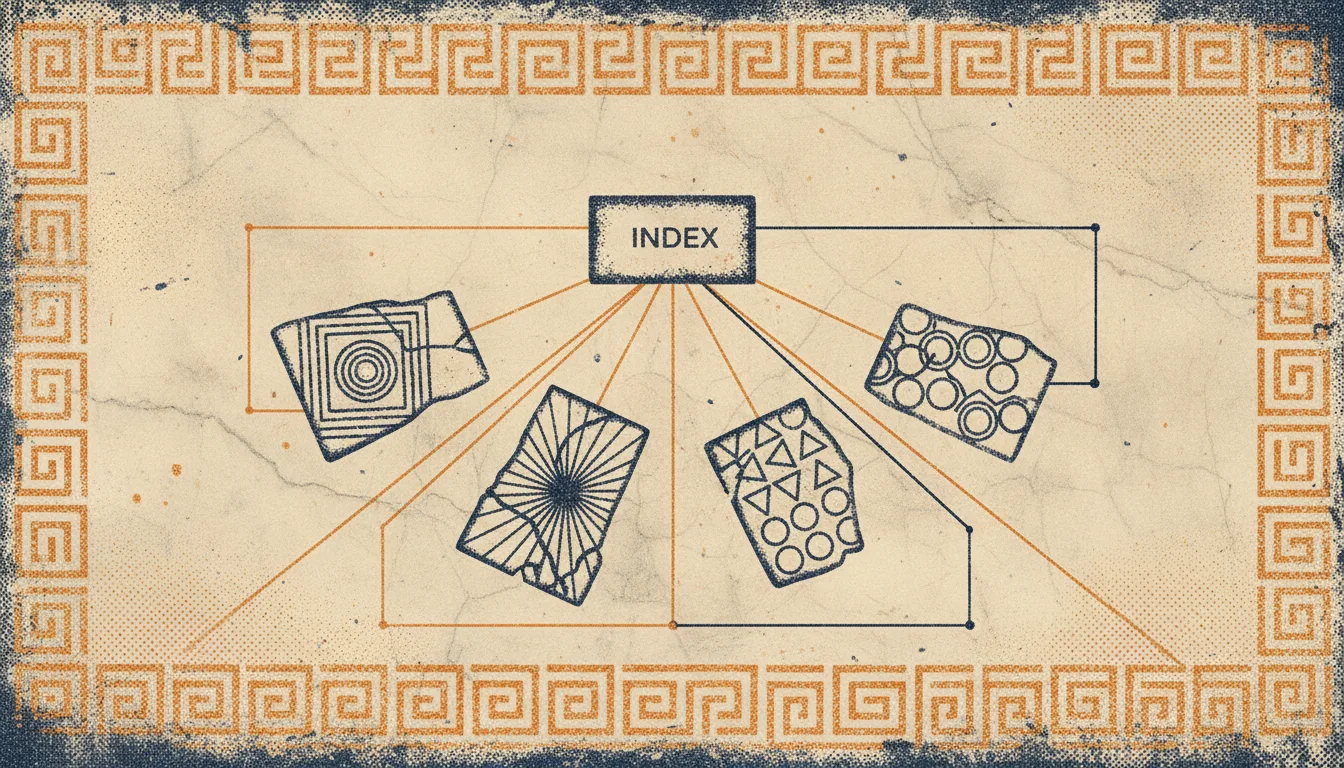

La regla de división para sitios a escala

Un único archivo de sitemap admite hasta 50.000 URLs o 50 MB sin comprimir, lo que ocurra primero. Cuando supera cualquiera de los dos límites, debe dividir el archivo y referenciar todas las partes desde un índice de sitemaps.

Un índice de sitemaps tiene la misma forma que un sitemap, pero lista sitemaps en lugar de URLs:

<?xml version="1.0" encoding="UTF-8"?>

<sitemapindex xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<sitemap>

<loc>https://example.com/sitemap-paginas.xml</loc>

<lastmod>2026-04-22</lastmod>

</sitemap>

<sitemap>

<loc>https://example.com/sitemap-productos-1.xml</loc>

<lastmod>2026-04-22</lastmod>

</sitemap>

<sitemap>

<loc>https://example.com/sitemap-productos-2.xml</loc>

<lastmod>2026-04-20</lastmod>

</sitemap>

</sitemapindex>El propio índice también está limitado: hasta 50.000 entradas de sitemap dentro de un índice. Eso da un techo teórico de 2.500 millones de URLs por índice, mucho más de lo que cualquier sitio normal va a necesitar.

La estrategia de división importa más de lo que sugieren los límites. Tres patrones son habituales.

Por tipo de contenido. Un sitemap para páginas estáticas, otro para entradas de blog, otro para páginas de producto, otro para páginas de etiquetas. Es el más legible y el más fácil de mantener cuando una sección crece más rápido que otra.

Por fecha. Útil para sitios de noticias o cualquier sitio con un eje temporal fuerte. Sitemaps con nombres como sitemap-2026.xml y sitemap-2025.xml abaratan las actualizaciones incrementales, ya que los sitemaps por fecha antiguos rara vez cambian.

Por segmento. Los grandes ecommerce dividen los sitemaps de productos en productos-1.xml hasta productos-N.xml mediante módulo simple o sharding. Cada shard se mantiene por debajo de las 50.000 URLs a medida que crece el catálogo.

Sea cual sea el esquema que elija, documéntelo. La siguiente persona que edite su pipeline de sitemap necesitará entender la convención para evitar la deriva.

Una pregunta habitual de escala: ¿debe comprimir sus sitemaps con gzip? El protocolo lo permite y los crawlers aceptan nombres .xml.gz. El límite de 50 MB se aplica al tamaño sin comprimir. La compresión ahorra ancho de banda en la transferencia, pero no cambia el techo efectivo de URLs.

Qué va dentro y qué no

La regla única que evita la mayoría de problemas de sitemap es esta: solo URLs canónicas, indexables y con estado 200 pertenecen a un sitemap. Todo lo demás es ruido que desperdicia presupuesto de rastreo y confunde las decisiones de indexación.

Páginas que deben incluirse:

- La versión canónica de cada página que quiera indexar

- Páginas públicas que respondan con HTTP 200

- Páginas cuyo

<meta name="robots">no contenganoindex - Páginas no bloqueadas por

robots.txt

Páginas que deben excluirse:

- Páginas marcadas como

noindex. Listar una página noindex en el sitemap es el conflicto silencioso más común, y Google lo califica de señal confusa en la ayuda de Search Console - URLs redireccionadas (3xx). El sitemap debe listar el destino, no la fuente

- Páginas de error (4xx y 5xx). Obvio, pero aparecen cuando la generación del sitemap no comprueba códigos de estado

- URLs bloqueadas por

robots.txt. Listar una URL bloqueada es una contradicción - URLs duplicadas que no son canónicas. Si

/paginay/pagina?ref=newsletterfuncionan, solo la versión canónica pertenece - URLs con parámetros de navegación facetada, ordenación o seguimiento de sesión

- Páginas tras autenticación, incluidos paneles de administración

El sitemap es una señal positiva, no una lista de cada URL existente. Quitar ruido del sitemap es una de las tareas técnicas de SEO de mayor impacto en sitios grandes, porque restringe directamente lo que el crawler considera digno de su tiempo.

Una verificación mental útil: si una URL no apareciera como un resultado de búsqueda del que se sentiría orgulloso, probablemente no debería estar en su sitemap.

Sitemaps especializados: imagen, vídeo, noticias

El protocolo base cubre páginas HTML. Tres extensiones oficiales cubren otros tipos de contenido.

Sitemaps de imágenes. Un sitemap de imágenes es un sitemap regular con bloques <image:image> adicionales dentro de cada entrada <url>. Cada bloque declara una URL de imagen alojada en una página. Útil para portafolios, catálogos ecommerce y cualquier sitio donde la búsqueda de imágenes sea una fuente significativa de tráfico. Puede incluir hasta 1.000 imágenes por entrada de página.

<url>

<loc>https://example.com/productos/silla</loc>

<image:image>

<image:loc>https://example.com/imagenes/silla-frente.jpg</image:loc>

</image:image>

<image:image>

<image:loc>https://example.com/imagenes/silla-lateral.jpg</image:loc>

</image:image>

</url>Sitemaps de vídeo. Un sitemap de vídeo declara objetos de vídeo con miniatura, duración y URLs de contenido. Necesario para sitios cuyos vídeos quieran aparecer en la búsqueda de vídeo y en resultados enriquecidos estructurados. La mayoría de plataformas modernas emiten schema de vídeo directamente en la página, lo que reduce la necesidad de un sitemap de vídeo separado, pero el sitemap sigue siendo la vía más limpia para asegurar un descubrimiento consistente.

Sitemaps de noticias. Un sitemap de noticias está restringido a artículos publicados en los últimos dos días. Es el punto de entrada a Google News, y el formato exige <news:publication>, <news:publication_date> y <news:title>. Solo los sitios aceptados en Google News deberían generar uno. Para el resto, un sitemap normal con un lastmod preciso hace el mismo trabajo de cara al ranking.

Puede mezclar entradas especializadas en el mismo archivo que sus entradas regulares de URL, o separarlas en sitemaps dedicados y referenciar ambos desde el índice. El enfoque dedicado es más limpio a escala porque cada generador puede ejecutarse según su propio calendario.

Enviar y declarar el sitemap

Dos canales entregan el sitemap a un crawler.

Declaración en robots.txt. Añada una línea Sitemap: al final de su archivo robots.txt con la URL absoluta del sitemap o del índice de sitemaps. Es el canal universal y funciona para cualquier crawler que respete robots.txt, incluidos Bing, Yandex, OpenAI y Anthropic.

User-agent: *

Allow: /

Sitemap: https://example.com/sitemap.xmlPuede declarar varias URLs de sitemap, una por línea. No hay límite de tasa para esta declaración, y los crawlers irán a buscar el archivo periódicamente.

Envío en Search Console. Google Search Console y Bing Webmaster Tools aceptan envíos manuales de sitemap. La ventaja es la información: cada herramienta indica cuántas URLs se enviaron, cuántas están indexadas y cuáles fueron excluidas. Para sitios que ya tienen integración de analítica con estas herramientas, el envío manual da feedback más rápido sobre errores de parseo que esperar al rastreo.

El envío vía Search Console no sustituye la declaración en robots.txt. Haga siempre las dos. Otros crawlers, incluidos los crawlers de IA de OpenAI y Perplexity, no ven el envío en Search Console y dependen exclusivamente de la línea en robots.txt.

Validar su sitemap

Un sitemap puede ser inválido de tres maneras distintas. Cada una requiere un paso de validación diferente.

Validez de esquema. ¿El archivo se analiza como XML y cumple el XSD del sitemap? Un ampersand sin escapar o una etiqueta de cierre ausente rompe el archivo entero. La comprobación más simple es cargar la URL en un navegador. Si el navegador muestra un error de parseo, el sitemap está roto. Para una validación más profunda, herramientas en línea como el validador XML del W3C comprueban la buena formación y la conformidad del DOCTYPE.

Vivacidad de las URLs. ¿Las URLs dentro del sitemap responden de verdad con 200? Un patrón de fallo habitual es un sitemap que lista 50.000 URLs, de las cuales 8.000 ahora devuelven 404 porque el contenido se eliminó sin actualizar el generador. Al parser del sitemap no le importa, pero el crawler desperdicia presupuesto golpeando URLs muertas. Un crawl completo de cada URL del sitemap es la única forma fiable de confirmar la vivacidad. Herramientas como Seodisias ejecutan esta verificación automáticamente como parte de una auditoría de sitemap.

Consistencia con el resto del sitio. ¿Las URLs del sitemap son canónicas, indexables y no están bloqueadas? Esta es la comprobación más profunda. Compara las entradas del sitemap con las respuestas en vivo del sitio, las etiquetas canonical, las directivas meta robots y las reglas de robots.txt. Cada conflicto es un error silencioso. Una URL noindex en el sitemap, una URL Disallow listada para rastreo, una entrada de sitemap que redirige con 301 a otra URL, todo eso se contradice. No producirá errores, pero erosionará la confianza que el motor de búsqueda deposita en su sitemap como señal limpia.

El informe de sitemap de Search Console muestra los conflictos más habituales, pero va por detrás de los rastreos en tiempo real y puede tardar días en actualizar. En sitios productivos, programe una auditoría de sitemap como parte de su rutina técnica mensual de SEO. En sitios en migración activa, hágalo semanalmente.

Los seis errores silenciosos

Algunos errores de sitemap son ruidosos. Un 500 cuando el crawler trae el archivo, un fallo de parseo XML, un namespace ausente, todos quedan registrados en Search Console con marcas rojas. Los errores más difíciles son los que no producen ninguna advertencia y degradan la señal en silencio.

Listar páginas noindex. La página devuelve 200 y una meta noindex. El sitemap la lista. El crawler llega, sigue la directiva meta y la quita del índice. La señal que envió (por favor indexa esto) y la señal de la página (no indexes esto) se cancelan entre sí.

Listar URLs redireccionadas. El sitemap lista /pagina-vieja. La página emite un 301 a /pagina-nueva. El crawler sigue la redirección, indexa con el tiempo /pagina-nueva, pero el sitemap nunca se actualiza. Con el tiempo, el sitemap acumula punteros a URLs que ya no responden directamente.

Valores lastmod desactualizados. Un <lastmod> de hace tres años indica al crawler que esta URL no ha cambiado en años. Si la página se actualizó ayer, el crawler quizá omita el rerastreo. Lo contrario también es problema: un <lastmod> actual en una página que no ha cambiado entrena al crawler para ignorar el campo.

Protocolos mezclados. Algunas entradas apuntan a http://, otras a https://. Después de migrar el sitio por completo a HTTPS, las entradas http o redirigen o devuelven 404. De cualquier forma, la mitad del sitemap se desperdicia.

Barras finales inconsistentes. El sitio canoniza a /pagina/ pero el sitemap lista /pagina sin la barra. Cada entrada redirige, costando un salto de rastreo en cada URL del sitemap.

Sitemap no declarado en robots.txt. Enviarlo por Search Console funciona para Google, pero todo otro crawler depende de la línea en robots.txt. Sin ella, los crawlers de IA y los motores de búsqueda más pequeños pueden no descubrir el sitemap en absoluto.

Estos seis errores comparten una propiedad. Ninguno produce una advertencia. El sitemap sigue siendo técnicamente válido, el crawler lo consume igual, pero la señal pierde claridad en silencio. La única forma de exponerlos es comparar lado a lado el sitemap con la respuesta en vivo del sitio. Esa comparación es exactamente lo que hace un crawler de SEO.

Conclusión

Un sitemap limpio es una señal constante de intención. Dice, cada semana o cada día, aquí están las URLs canónicas, indexables y vivas que quiero que un motor de búsqueda considere. En el momento en que esa señal deja de coincidir con la realidad, el sitemap deja de hacer su trabajo.

Construya el archivo a partir de sus canónicas indexables, no a partir de la lista completa de URLs. Divida en el límite de escala con la convención que encaje con su contenido. Valide en tres niveles: esquema, vivacidad y consistencia. Declare el sitemap en robots.txt y envíelo a Search Console para el reporte. Audite con calendario, mensual para sitios estables y semanal durante migraciones. Para una coordinación interna más profunda, combine las auditorías de sitemap con revisiones de presupuesto de rastreo, cadenas de redirección y su rutina de crawler de SEO.

Si necesita una herramienta para correr el crawl, descargue Seodisias gratis. Funciona localmente en su máquina, no tiene límites de URLs y produce informes de sitemap como parte de cada auditoría, incluida vivacidad, coincidencia canónica e indexabilidad por entrada.