Crawl Budget für Ecommerce: Googlebot nicht an Filtern verschwenden

Ein Shop mit 5.000 Produkten klingt überschaubar, bis Sie die URLs zählen. Fügen Sie fünf Filterfacetten, drei Sortieroptionen, Paginierung und Farbvarianten hinzu, und Googlebot hat plötzlich eine halbe Million URLs zur Auswahl. Das meiste davon wollen Sie gar nicht im Index haben, und jede Anfrage, die dort landet, ist eine Anfrage weniger für den neuen Artikel, den Sie heute Morgen veröffentlicht haben. Dieser Beitrag behandelt die sechs Wege, auf denen Onlineshops ihr Crawl Budget verlieren, und die Korrekturen, die im echten Traffic wirklich halten.

Warum Onlineshops ihr Crawl Budget anders verschwenden

Eine Contentseite hat grob eine URL pro einzigartiger Seite. Ein Onlineshop nicht. Jede Produktseite kann sich in Varianten für Größe, Farbe und Material aufteilen. Jede Kategorieseite kann sich in gefilterte Ansichten, Sortierreihenfolgen und Paginierung aufteilen. Jede Aktion kann einen Trackingparameter anhängen. Wenn Sie interne Suche und Affiliatelinks hinzurechnen, kann die Zahl der URLs 50 bis 100 Mal höher liegen als die Zahl der Seiten, die tatsächlich organischen Traffic bringen.

Googlebot weiß nicht, welche dieser URLs einen Besuch wert sind. Er entdeckt sie über interne Links, Sitemaps und externe Backlinks und plant seine Crawls danach, wie oft sich eine URL ändert und wie wichtig sie wirkt. Wenn Ihre Seite Googlebot weiterhin auf Filterkombinationen zeigt, kommt er immer wieder darauf zurück. Ihre echten Produktseiten warten derweil in der Schlange.

Die zweite Komplikation ist die Serverlast. Shopsysteme wie Magento, Shopify Plus und große WooCommerce Installationen sind schwerer als ein Blog. Warenkorb, Lagerverwaltung und Personalisierung laufen bei jeder Anfrage. Wenn die Antwortzeiten steigen, reduziert Google automatisch seine Crawl Rate. Googles eigene Empfehlungen für große Websites bestätigen, dass ein langsamer Server direkt begrenzt, wie viele Seiten pro Tag abgerufen werden.

Die Kosten summieren sich über den Kalender. Ein neues Produkt, das montags eingestellt wird, wird vielleicht erst am folgenden Wochenende indexiert. Eine saisonale Kollektion, die drei Wochen vor Saisonbeginn online geht, verpasst möglicherweise das ganze Zeitfenster. Für eine Contentseite ist eine langsame Indexierung ärgerlich. Für einen Shop ist sie entgangener Umsatz.

Wenn Sie neu in diesem Thema sind, behandelt wie Crawl Budget wirklich funktioniert die Grundlagen. Der Rest dieses Beitrags setzt voraus, dass Sie die Basics kennen und das spezifische Playbook für Ecommerce suchen.

Die sechs größten Killer des Crawl Budgets in Onlineshops

Jeder Onlineshop verliert mehr oder weniger an den gleichen Stellen. Die Dateinamen und Plattformen ändern sich, aber die Muster sind dieselben.

Die Explosion der Facettennavigation

Facettennavigation erlaubt Käufern, eine Kategorie nach Größe, Farbe, Marke, Preisspanne und Material einzugrenzen. Jede Facette wirkt für sich genommen harmlos. Das Problem ist die Kombinatorik. Eine Jackenkategorie mit fünf Facetten und jeweils vier Optionen erzeugt 1.024 Varianten an URLs, und das, bevor Sie Sortierreihenfolge oder Paginierung einrechnen.

Die meisten Plattformen verlinken in der Seitenleiste standardmäßig zu jeder Facette. Googlebot folgt diesen Links und indexiert jede Ergebnisseite als eigenständige URL. Aus seiner Sicht ist category/jackets?color=red&size=m&brand=northface&sort=price eine andere Seite als category/jackets?color=red&size=m&brand=northface. Multiplizieren Sie das über jede Kategorie der Seite hinweg, und die Zahl der URLs geht in die Millionen.

Die Lösung ist nicht, Filter zu entfernen. Käufer brauchen sie. Die Lösung ist, zu entscheiden, welche Kombinationen es wert sind, Suchmaschinen offen zu stehen, und den Rest nur als Nutzerfunktion zu behandeln, unsichtbar für Bots.

Eigene URLs für Produktvarianten

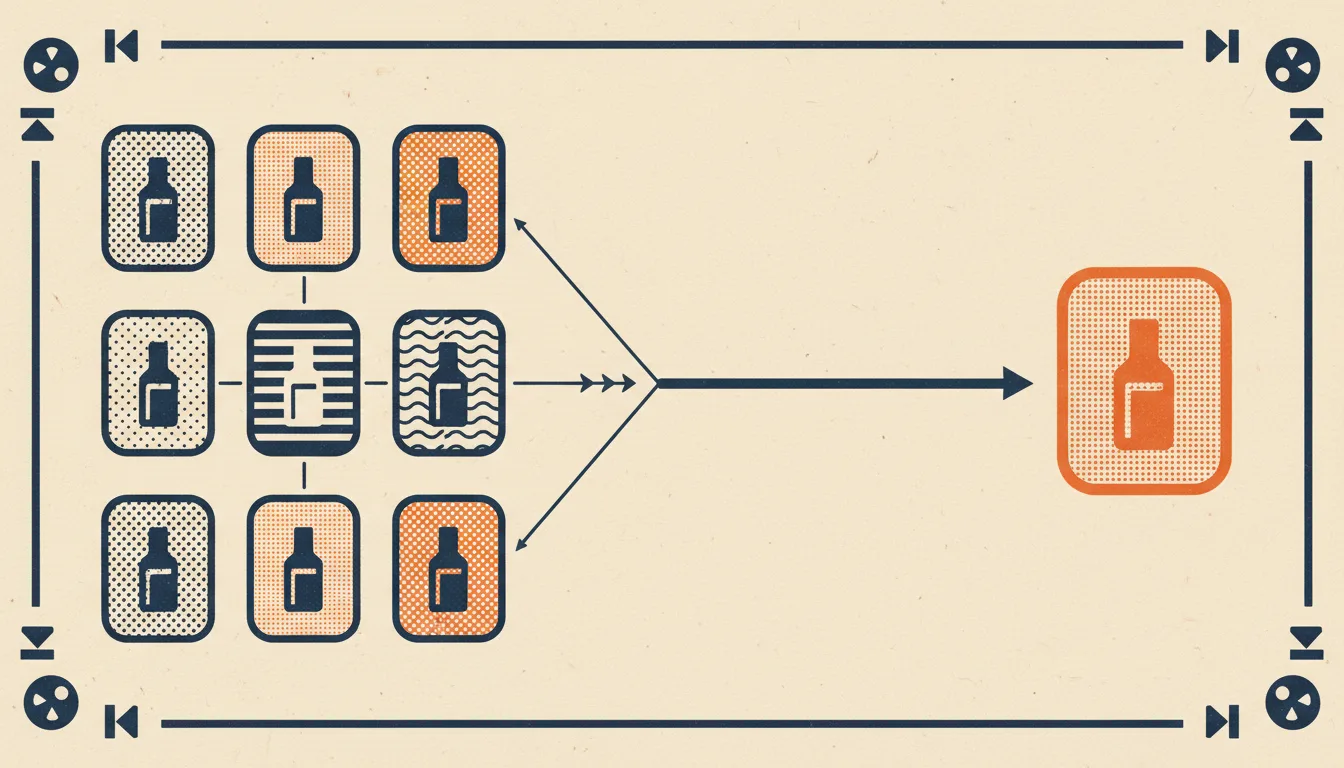

Viele Plattformen geben jeder Kombination aus Farbe und Größe eine eigene URL. Ein Hemd, das in zehn Farben und fünf Größen verfügbar ist, wird zu fünfzig URLs, alle mit nahezu identischem Inhalt. Google sieht fünfzig Duplikate und verbraucht fünfzig Crawlanfragen für etwas, das eine einzige Produktseite sein sollte.

Schlimmer noch: Die URLs der Varianten konkurrieren oft miteinander um dieselbe Suchanfrage. Eine Suche nach dem Hemdnamen kann jede der fünfzig zurückgeben, oder keine, weil Google nicht entscheiden kann, welche Variante ranken soll.

Einige Varianten verdienen eine eigene URL. Wenn “rote Laufschuhe” messbare Suchnachfrage hat, kann die rote Variante eine eigenständige Seite rechtfertigen. Die meisten Varianten erreichen diese Schwelle nicht und sollten im Elternprodukt konsolidiert werden.

Interne Suche und Sortierparameter

Interne Suchseiten wie ?q=jacket erzeugen einen unendlichen Raum an URLs. Jede Anfrage, die ein Käufer eingibt, wird zu einer crawlbaren URL, sobald sie irgendwo verlinkt wird, auch in Analytics Dashboards oder Affiliate Reports. Sortierparameter tun dasselbe. ?sort=price_asc, ?sort=price_desc, ?sort=newest und ?sort=popularity erzeugen jeweils eigene URLs, die denselben Inhalt in anderer Reihenfolge zeigen.

Googlebot interessiert die Reihenfolge nicht. Ihn interessiert, dass es vier URLs gibt, wo eine reichen würde. Wenn Ihre Plattform zusätzlich Parameter für Sprache oder Währung anhängt, multipliziert sich die Zahl weiter.

Paginierungssequenzen auf Kategorieseiten

Eine Kategorie mit 400 Produkten und 20 Produkten pro Seite erzeugt 20 paginierte Ansichten. Seite 1 hat vielleicht Wert. Seite 14 wahrscheinlich nicht. Der alte Hinweis rel=next/prev wird von Google nicht mehr als Indexierungssignal unterstützt, also gibt es keinen einfachen Weg, ihm zu sagen, dass diese Seiten zu einer Reihe gehören.

Lange Paginierungsreihen erzeugen auch verwaiste Produkte. Ein Produkt, das nur auf Seite 17 einer Kategorie erscheint, wird selten entdeckt. Googlebot besucht diese Seite vielleicht einmal im Monat und vergisst sie dann wieder, bis etwas anderes sie erneut ins Licht rückt.

Nicht vorrätige und eingestellte Produkte

Seiten nicht vorrätiger Produkte stehen in einer unklaren Mittelposition. Wenn Sie sie löschen, verlieren Sie die Linkkraft, die sie angesammelt haben. Wenn Sie sie als Antworten mit Status 200 und leerem Zustand behalten, crawlt Googlebot sie weiter und wundert sich, warum sie nichts zeigen. Wenn Sie zu aggressiv 404 zurückgeben, verlieren Sie die Chance, Käufer zurückzuholen, sobald der Bestand wieder da ist.

Eingestellte Produkte sind schlimmer. Eine Seite, die ihren Katalog häufig wechselt, endet oft mit Tausenden toter URLs, die immer noch von alten Kategorieseiten, Emailkampagnen und Affiliatenetzwerken verlinkt werden. Jede davon ist eine Crawlanfrage ohne Indexwert.

Session IDs und Trackingparameter

?utm_source=, ?fbclid=, ?gclid=, ?affiliate_id= und Session Tokens der Plattform erzeugen alle Varianten derselben Seite. Wenn Ihre Produktfeeds Trackingcodes in den URLs enthalten, erzeugt jeder Affiliateklick eine neue URL in der Wildnis. Googlebot findet sie über Backlinks und crawlt sie, als wären sie neuer Inhalt.

Onlineshops werden davon härter getroffen als Contentseiten, weil ihre Marketingprogramme viel mehr Parametervarianten erzeugen, und diese Varianten reisen durch Emails, bezahlte Anzeigen und Partnernetzwerke.

Wie Sie die Crawlverschwendung in Ihrem Onlineshop auditieren

Sie können nicht beheben, was Sie nicht sehen. Bevor Sie etwas in robots.txt oder an Canonical Tags ändern, kartieren Sie, was Googlebot auf Ihrer Seite tatsächlich tut.

Beginnen Sie mit einem Desktopcrawler, der auf Ihre eigene Domain zeigt. Wenn Sie neu in dieser Art von Audit sind, erklärt was ein SEO Crawler wirklich macht die zugrunde liegenden Mechanismen. Ein Werkzeug, das robots.txt standardmäßig respektiert, gibt Ihnen einen sauberen Überblick darüber, was auffindbar ist, einschließlich jedes Filterlinks, jeder paginierten Seite und jeder URL einer Variante. Vergleichen Sie diese Zahl mit der Zahl einzigartiger Produkte in Ihrem Katalog. Wenn der Crawler 800.000 URLs findet und Ihre Datenbank 20.000 Produkte hat, wissen Sie, wo Sie anfangen müssen zu suchen.

Als Nächstes ziehen Sie die XML Sitemap heraus und vergleichen sie mit dem Crawl. Seiten, die in der Sitemap stehen, aber im Crawl fehlen, sind verwaist. Seiten, die im Crawl auftauchen, aber in der Sitemap fehlen, sind Kandidaten für Verschwendung. Beide Listen verdienen Aufmerksamkeit.

Öffnen Sie dann Google Search Console und prüfen Sie den Bericht Crawl Stats unter Einstellungen. Der Bericht schlüsselt Anfragen nach Zweck auf (Entdeckung, Aktualisierung, Fehler) und nach Antworttyp. Achten Sie auf hohe Zahlen von Redirects oder Serverfehlern. Das sind günstige Gewinne. Alle Details zum Bericht finden Sie in der Dokumentation der Crawl Stats in der Search Console.

Den vollständigsten Überblick liefern rohe Serverlogs. Filtern Sie auf verifizierten Googlebot Traffic und schauen Sie, welche URLs die meisten Treffer bekommen. In einem typischen Onlineshop werden die 50 am häufigsten gecrawlten URLs nicht mit den 50 wichtigsten Produkten übereinstimmen. Diese Diskrepanz ist das Problem des Crawl Budgets in Zahlen.

Hier ein kurzer Überblick darüber, was jede Methode zeigt und was sie übersieht.

| Methode | Stärken | Blinde Flecken |

|---|---|---|

| Desktopcrawler | Vollständiges Inventar der URLs, Prüfung der Canonical Tags, Duplikaterkennung | Kann nicht sagen, was Googlebot wirklich abruft |

| Search Console Crawl Stats | Echte Aktivität von Googlebot, Antwortcodes, Trends | Aggregiert, verzögert, stichprobenartig |

| Analyse der Serverlogs | Exaktes Verhalten von Googlebot, Detail zu jeder URL | Benötigt Zugriff auf die Logs und Aufwand für die Auswertung |

Alle drei parallel laufen zu lassen, ist das zuverlässigste Setup. Wenn Sie nur für eine Methode Zeit haben, beginnen Sie mit einem Desktop Crawl und legen Search Console darüber.

Praktische Korrekturen, die wirklich etwas bewegen

Sobald die Verschwendung kartiert ist, können Sie Korrekturen in der Reihenfolge ihrer Wirkung anwenden. Nicht jede Korrektur zählt für jede Seite. Die Reihenfolge unten spiegelt wider, was bei einem typischen Katalog am meisten hilft.

Eine Strategie für die Facettennavigation entwerfen

Beginnen Sie mit Ihrer eigenen Analytik. Schauen Sie, welche Filterkombinationen tatsächlich organischen Traffic erhalten. In den meisten Katalogen bringen wenige Facetten fast den gesamten Suchwert. “Rote Laufschuhe” und “wasserdichte Wanderjacken” bekommen vielleicht Suchanfragen. “Mittelgroße rote wasserdichte Größe 9 Polyester Schuhe” nicht.

Befördern Sie die Kombinationen, die Traffic einbringen, zu eigenständigen Landingpages. Geben Sie ihnen eine eigene URL, einen eigenen Titel und eine eigene Beschreibung, eigene interne Links und einen Platz in der Sitemap. Sperren Sie den Rest komplett vom Crawl aus. Das geht mit Disallow Regeln in der robots.txt, die auf die Parametermuster abzielen, oder indem Sie weniger wichtige Filter auf AJAX umstellen, das die URL nicht verändert.

Eine mittlere Option ist, die URL zu behalten, sie aber als noindex, follow zu markieren. Das lässt Google die Seite crawlen, um neue Produkte darunter zu entdecken, ohne sie in den Index aufzunehmen. Bei großen Katalogen verbraucht das immer noch Crawl Budget, also ist disallow meist die bessere Wahl für alles, was keinen Traffic bringt.

Produktvarianten sauber handhaben

Wählen Sie eine kanonische Variante für jedes Produkt. Die, die die meisten Leute kaufen, die neutrale Farbe oder die Standardgröße funktioniert gut. Zeigen Sie die URL jeder anderen Variante mit einem rel="canonical" Tag auf diese kanonische URL. Das sagt Google, welche Variante es in der Suche anzeigen soll, und konsolidiert die Signale über alle hinweg.

Wenn eine bestimmte Variante echte eigene Suchnachfrage hat, geben Sie ihr eine eigene Seite mit einzigartigem Inhalt. Dieser Inhalt muss die getrennte URL rechtfertigen. Ein anderes Farbfoto reicht nicht. Ein anderer Einsatzzweck, andere Größeninformationen oder eine andere saisonale Positionierung können es.

Für den Rest lassen Sie den Käufer die Variante auf einer einzigen Produktseite mit JavaScript auswählen. Die URL bleibt stabil, der Crawler besucht sie einmal, und alle Varianteninformationen leben im selben HTML.

Die XML Sitemap für Ecommerce aufräumen

Ihre Sitemap sollte nur Produkte enthalten, die auf Lager, indexierbar und kanonisch sind. Entfernen Sie Einträge, die umleiten, Fehler zurückgeben oder durch robots.txt blockiert sind. Teilen Sie die Datei nach Kategorie auf, wenn Sie mehr als 50.000 Produkte pro Sitemap haben, damit die Plattform lesbar bleibt und lastmod Datumsangaben sinnvoll bleiben.

Setzen Sie lastmod auf Basis echter Inhaltsänderungen. Die gesamte Sitemap nächtlich mit dem heutigen Datum auf jedem Eintrag zu regenerieren, ist ein häufiger Fehler. Google lernt, Daten zu ignorieren, die sich ständig bewegen, und so verliert das Signal jede Bedeutung.

Wenn Sie saisonale Produkte haben, setzen Sie sie in dem Moment zurück in die Sitemap, in dem sie wieder auf Lager sind. Der erste Crawl nach dieser Änderung entscheidet, ob das Produkt den frühen Traffic der Saison einfängt.

Von gecrawlten Seiten zu Umsatzseiten verlinken

Interne Links sind das stärkste Signal, das Sie darüber senden können, welche Seiten wichtig sind. Seiten, die Googlebot oft crawlt, werden zu Hubs. Jede Seite, die von einem Hub verlinkt ist, erbt einen Teil dieser Crawlpriorität.

Prüfen Sie Ihre Startseite, Ihre drei wichtigsten Kategorien und Ihre zehn wichtigsten Produkte. Auf welche Seiten verlinken sie? Wenn eine neue Einführung vier Klicks tief hinter Paginierung vergraben ist, bleibt sie unindexiert, bis ein externes Signal sie anhebt. Wenn dieselbe Einführung von der Startseite und der Kategorieseite prominent beworben wird, wird sie meist innerhalb eines Tages indexiert.

Die einfache Regel: Bestseller und Neuheiten gehören nahe an die Spitze der Seiten, die Googlebot am meisten besucht. Breadcrumbs, verwandte Produkte und redaktionelle Module sind alles nützliche Werkzeuge, um Linkkraft zu verteilen. Für eine tiefere Analyse deckt die vollständige Checkliste für ein Technical SEO Audit die Prüfungen der internen Links ab, die sich neben der Arbeit am Crawl Budget lohnen.

So überwachen Sie nach der Bereinigung

Eine Bereinigung zählt nur, wenn sie hält. Die Kataloge von Onlineshops ändern sich ständig. Neue Produkte, neue Kategorien, neue Kampagnen und Plattformupdates schaffen alle Möglichkeiten für frische Verschwendung.

Beobachten Sie Ihre Crawlstatistiken wöchentlich im ersten Monat nach einer wichtigen Änderung. Die entscheidende Kennzahl ist das Verhältnis erfolgreicher Antworten zu allen Anfragen. Ein gesunder Wert liegt deutlich über 90 Prozent. Eine Bereinigung, die Verschwendung reduziert hat, sollte dieses Verhältnis innerhalb von zwei bis drei Wochen nach oben bewegen, während Google sich an die neue Form der Seite anpasst.

Verfolgen Sie die Zeit bis zur Indexierung neuer Produkteinführungen als Frühindikator. Veröffentlichen Sie das Produkt, notieren Sie den Zeitstempel und beobachten Sie, bis es im Index erscheint. Vor der Bereinigung dauert das vielleicht Tage. Nach der Bereinigung sollte es in einem typischen Shop innerhalb von 24 bis 48 Stunden passieren. Wenn sich die Zahl nicht bewegt, haben Ihre Korrekturen die Seiten nicht erreicht, auf die es ankommt.

Lassen Sie Ihren Desktop Crawl jeden Monat erneut laufen. Neue Crawlverschwendung hat die Angewohnheit, sich zurückzuschleichen. Ein Marketingteam aktiviert einen neuen Trackingparameter, ein Plugin fügt einen neuen Filter hinzu, eine Migration hinterlässt eine Redirectkette. Das monatliche Audit fängt das ab, bevor sich daraus Monate verschwendeter Besuche ansammeln. Für die Workflows rund um übrig gebliebenen Ballast passt wie Sie kaputte Links finden und beheben natürlich zum regelmäßigen Crawlaudit.

Schließlich setzen Sie eine tiefere Überprüfung pro Quartal an. Bauen Sie die Whitelist der Facetten neu auf, prüfen Sie die Behandlung der Varianten, bewerten Sie die Sitemap neu und bestätigen Sie, dass Ihre wichtigsten Produkte noch dort im internen Linkgraphen sitzen, wo sie sein sollten. Ein Quartalsdurchgang hält die Bereinigung davon ab, innerhalb eines Jahres zu einem weiteren Auditprojekt zu verfallen.

Fazit

Das Crawl Budget in einem Onlineshop ist ein strukturelles Problem, kein einzelner Fehler. Die Verschwendung kommt aus der Form der Plattform, den daran hängenden Marketingprogrammen und der Art, wie Käufer stöbern müssen. Nichts davon verschwindet. Was sich ändert, ist, ob Sie mit der Form arbeiten oder gegen sie.

Beginnen Sie mit dem Audit. Finden Sie die sechs Killer in Ihrem eigenen Katalog und notieren Sie, wie viele URLs jeder davon erzeugt. Beheben Sie zuerst die größten Lecks. Überprüfen Sie die Bereinigung in einem monatlichen Takt, damit die nächste Migration oder Kampagne die Arbeit nicht rückgängig macht. Über ein Jahr hinweg ist der Summeneffekt der Unterschied zwischen Produkten, die am selben Tag indexiert werden, und Produkten, die wochenlang in der Warteschlange stehen.

Wenn Sie ein lokales Werkzeug für den Auditteil suchen: Seodisias läuft auf Ihrem Rechner ohne Limit bei der URL Zahl, was wichtig wird, wenn Ihr Katalog eine halbe Million URLs zu prüfen hat. Kombinieren Sie es mit Loganalyse und einer Quartalsprüfung, und das Crawl Budget wird von einem unsichtbaren Abfluss zu einer Zahl, die Sie tatsächlich steuern können.