Interne Verlinkung als Crawl Budget Werkzeug: Muster, Ankertexte, Audits

Interne Links sind die Verkabelung einer Website. Jeder Link von einer Seite zur anderen sagt einer Suchmaschine, wohin als Nächstes zu gehen ist, wie oft zurückzukehren ist und welche Seiten am wichtigsten sind. Stimmt die Verkabelung, erreicht der Crawler genau das, was indexiert werden soll, in der Reihenfolge, die Priorität widerspiegelt. Stimmt sie nicht, bleiben die wichtigsten Seiten unter fünf Klicks Navigation begraben, während dünne Seiten die erste Reihe einnehmen.

Die meisten Hinweise zu interner Verlinkung kreisen um Ranking Signale oder Ankertext allein. Beides zählt, aber die tiefere Aufgabe interner Links ist strukturell. Sie sind der primäre Hebel dafür, wie ein Crawler sein Budget auf Ihrer Site verteilt. Dieser Leitfaden geht durch fünf Muster, die echte Probleme lösen, die Ankertext Regeln, die im Maßstab funktionieren, die Topic Cluster Form, die zur Lesart von KI Suche passt, die Probleme verwaister Seiten und Linktiefe, die Sichtbarkeit still untergraben, und die Audit Routine, die das Ganze in Form hält.

Interne Links als Crawl Budget Werkzeug

Ein Crawler kommt mit einem endlichen Budget. Googlebot, Bingbot, GPTBot, ClaudeBot, alle haben eine Grenze, wie viele Anfragen sie pro Sitzung stellen. Wo sie das Budget ausgeben, hängt von Ihrer Sitemap, Ihrer robots.txt und vor allem von den Links ab, die der Crawler in Ihren Seiten findet.

Eine Seite mit vielen eingehenden internen Links signalisiert Wichtigkeit. Der Crawler kommt häufiger zurück. Eine Seite mit einem oder zwei eingehenden Links liegt am Rand des Budgets, wird selten erneut gecrawlt. Eine Seite ohne eingehende Links ist unsichtbar, es sei denn, sie steht in der Sitemap, und selbst dann gilt sie als Entdeckung niedriger Priorität.

Das heißt, jeder interne Link ist auch eine Budgetentscheidung. Ein Link von der Startseite auf einen tiefen Blogpost zieht diesen Beitrag in eine Aufmerksamkeitszone hoher Frequenz. Lässt eine Kategorie fünfzig Links zu Long Tail Varianten zu, verschwendet sie Budget auf Seiten, die womöglich gar nicht existieren sollten. Dieselbe Crawl Budget Logik, die Crawl Budget Optimierung auf der technischen Seite treibt, hängt direkt damit zusammen, wie Sie Ihre internen Links verkabeln.

Für große Sites ist interne Verlinkung der Hebel mit der höchsten Wirkung nach sauberer robots.txt und Sitemap. Für kleine Sites ist sie der Unterschied zwischen klarer Architektur und einem Geflecht, durch das selbst Sie nach einem Jahr redaktioneller Drift nicht mehr durchsehen.

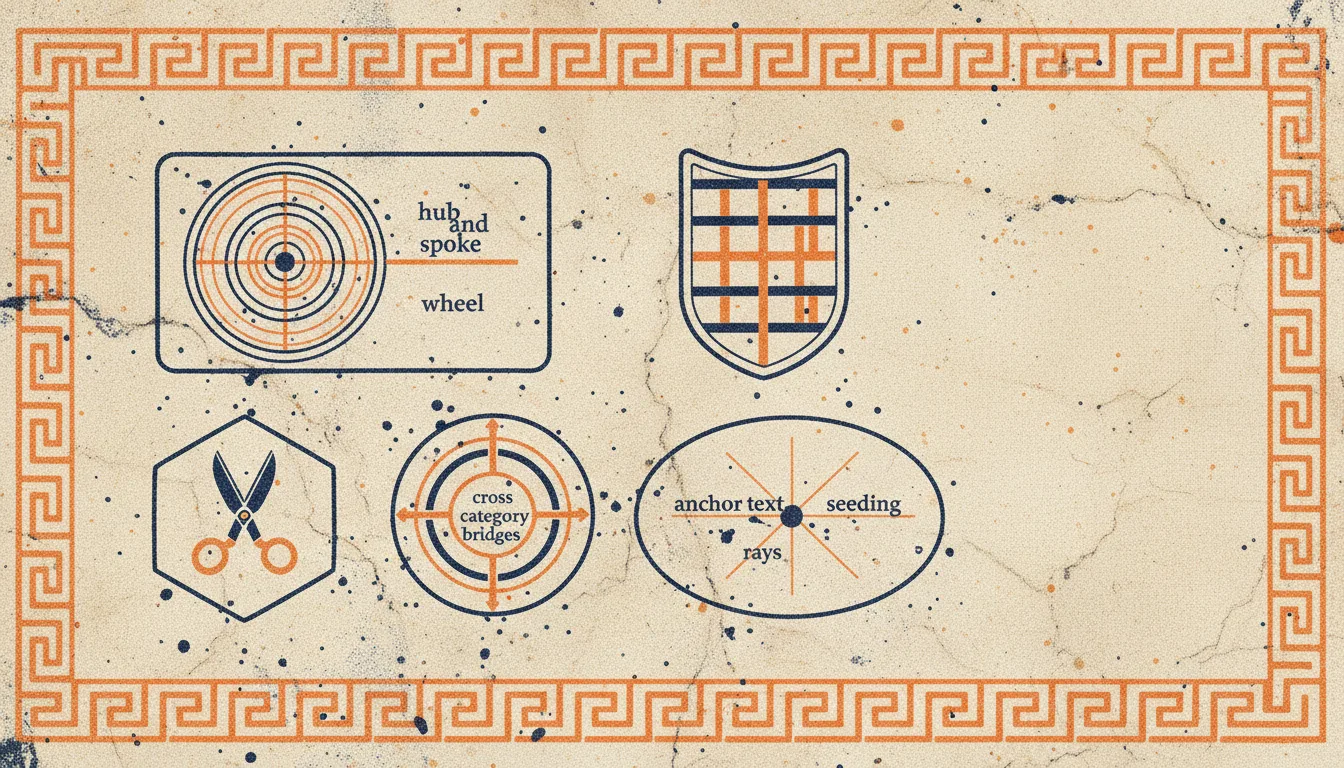

Fünf Muster, die echte Probleme lösen

Die fünf Muster decken fast jede reale Entscheidung in einer Inhalts oder E Commerce Site ab. Sie sind nicht erschöpfend, sie sind die mit dem höchsten Ertrag.

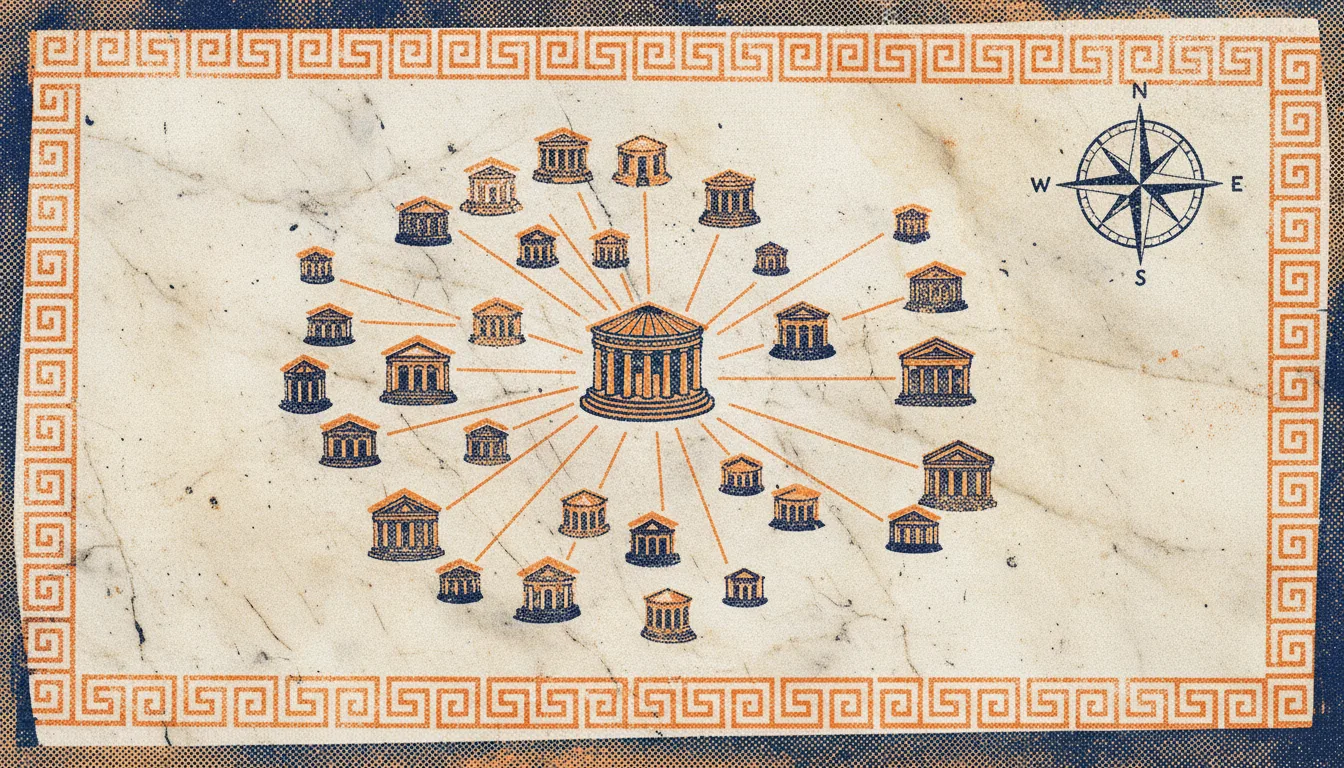

Hub und Spoke. Eine Pillar Seite deckt ein breites Thema ab. Jedes Unterthema bekommt eine eigene Seite, von der Pillar verlinkt. Die Unterseiten verlinken zurück zur Pillar. Das einfachste Cluster Muster, leicht zu planen, leicht zu auditieren. Nutzen Sie es für jedes Thema mit klarem Zentrum und mehreren spezifischen Facetten.

Tiefen Beschneidung. Je tiefer eine Seite in Ihrem Linkgraphen sitzt, desto weniger Crawl Aufmerksamkeit bekommt sie. Liegt eine kritische Conversion Seite vier Klicks tief von der Startseite, holen Sie sie hoch. Setzen Sie direkte Links von der Startseite, dem globalen Footer oder einem reichweitenstarken Blogpost. Linktiefe ist etwas, das Sie messen und verkürzen, nicht etwas, das das CMS für Sie entscheidet.

Brücken zwischen Kategorien. Sites mit mehreren Kategorien bauen oft Silos, die nie verbinden. Eine Seite in Kategorie A verlinkt nie eine verwandte Seite in Kategorie B, obwohl Leser natürlich zwischen beiden wechseln. Bauen Sie Brücken. Sie verteilen Crawl Aufmerksamkeit über eine Kategorie hinaus und spiegeln, wie Leser sich tatsächlich verhalten.

Ankertext Streuung. Jeder Linktext ist ein Signal. Verwenden Sie beschreibenden Ankertext, der die Intention der Zielseite trifft. Behandelt die Zielseite Crawl Budget, verlinken Sie mit den Worten “Crawl Budget”, nicht “hier klicken”. Pro Link klein, im Maßstab summiert es sich zu einem starken thematischen Signal.

Unproduktive Links beschneiden. Nicht jeder interne Link hilft. Links zu noindex Seiten, Weiterleitungen und 404 verbrauchen Crawl Budget, ohne etwas zurückzugeben. Auch übermäßige doppelte Links von einer einzelnen Seite. Periodisches Beschneiden ist Teil des Musters, kein separater Wartungsjob.

Ankertext in der Praxis

Ankertext ist eines der wenigen Signale, bei denen Sie ohne Manipulation präzise sein können. Der Text in einem <a> Tag teilt dem Crawler mit, worum es auf der Zielseite geht. Er teilt es auch dem Nutzer mit, was der wichtigere Zweck ist.

Regeln, die über Jahre Bestand haben:

- Beschreibend statt generisch. “Lesen Sie unseren Crawl Budget Leitfaden” ist besser als “hier klicken”. Der erste trägt Bedeutung, der zweite verschwendet den Link.

- Natürlich variieren über Seiten hinweg. Zwanzig Seiten mit identischem Anker zur selben Zielseite wirkt konstruiert. Variieren Sie die Formulierung im thematischen Rahmen. “Crawl Budget”, “Crawl Budget Optimierung”, “wie Google entscheidet, was zu crawlen ist”, verweisen alle auf dasselbe Konzept ohne den Eindruck eines Stempels.

- Keyword Stuffing vermeiden. Eine lange Keyword Reihenfolge als Anker liest sich als Spam. Eine beschreibende Phrase reicht.

- Auf Nutzerabsicht passen. Der Anker sollte spiegeln, was der Leser nach dem Klick erhält. Irreführende Anker schaden Vertrauen und steigern Absprungrate.

Ankertext Qualität zeigt sich im Audit als sauberes Histogramm. Visualisiert man alle Anker, die auf eine einzelne Seite zeigen, sieht eine gesunde Site eine moderate Streuung verwandter Formulierungen um ein klares thematisches Zentrum. Eine Site mit schwachen Signalen zeigt zufällige Begriffe ohne Konzentration.

Topic Cluster und Silos

Ein Topic Cluster ist ein Netz von Seiten rund um ein einzelnes breites Thema, mit einer Pillar Seite im Zentrum und mehreren Stützartikeln, die ein und ausgehend verlinken. Die Struktur spiegelt, wie KI Suchmaschinen eine Site auf thematische Autorität lesen. Eine Site mit einem Essay zu robots.txt wird wie ein Essay behandelt. Eine Site mit zwölf vernetzten Seiten zu Crawl Budget, robots.txt, Sitemaps, Weiterleitungsketten und Linktiefe wird auf technischem SEO Crawling als autoritativ eingestuft.

Das Cluster Muster zahlt an drei Fronten ein. Suchmaschinen sehen die thematische Konzentration. KI Engines wie ChatGPT, Perplexity und Claude bevorzugen Sites mit umfassender Abdeckung beim Auswählen von Zitaten. Und Leser, die auf einer Cluster Seite landen, haben einen offensichtlichen nächsten Schritt zu einer verwandten Seite, was Sitzungstiefe verlängert und Absprünge reduziert.

Silos sind eine strengere Variante. In einem Silo überschreiten interne Links nie Kategoriegrenzen. Die Crawl Budget Kategorie verlinkt nur andere Crawl Budget Seiten, nie Schema oder Hreflang. Silos waren in älteren SEO Empfehlungen beliebt, arbeiten aber oft gegen die Bewegung moderner Leser und KI Crawler. Eine Site, die sowohl organisiert als auch über Themen verbrückt ist, performt meist besser als eine starr siloierte.

Praktisch heißt das: clustern, nicht isolieren. Cluster um Kernthemen bauen. Brücken setzen, wo die Beziehung real ist. Erzwungene Querlinks, die keinem Leser dienen, vermeiden.

Verwaiste Seiten

Eine verwaiste Seite ist eine Seite Ihrer Site, auf die kein interner Link zeigt. Der Crawler erreicht sie nur über die Sitemap, und selbst dann gilt sie als niedrige Priorität. Waisen sammeln sich still, besonders auf Sites mit häufiger redaktioneller Aktivität. Ein Blogpost, der aus dem Menü fiel und live blieb, eine Landingpage einer alten Kampagne, eine umbenannte Kategorie, alles wird zur Waise, ohne dass es jemand merkt.

Waisen sind aus zwei Gründen schlecht. Die Seite verliert Crawl Frequenz, Updates brauchen länger bis in den Index. Und die Verwaisung ist oft ein Zeichen für ein tieferes Problem, dass keine andere Seite Ihrer Site diesen Inhalt für verlinkenswert hält. Wenn Ihre eigene Site nicht verlinkt, warum sollte eine Suchmaschine es als wichtig behandeln?

Die Lösung ist mechanisch. Vollständigen Crawl laufen lassen, Crawl Ergebnisse mit Sitemap und URL Liste aus dem CMS abgleichen, jede URL listen, die existiert aber keine eingehenden internen Links hat. Für jede Waise entscheiden: soll sie irgendwo verlinkt werden, soll sie auf eine relevante lebende Seite umgeleitet werden oder ganz entfernt werden? Eine Seite, die keinen Link verdient, verdient keinen Platz im Live Site.

Linktiefe

Linktiefe ist die Zahl der Klicks von der Startseite zu einer Zielseite. Seiten in Tiefe eins (direkt von der Startseite) erhalten die meiste Crawl Aufmerksamkeit. Seiten in Tiefe vier und tiefer erhalten viel weniger. Seiten in Tiefe sechs und tiefer werden so selten gecrawlt, dass Updates Wochen brauchen, um den Index zu erreichen.

Drei bis vier Klicks Tiefe ist eine gute Obergrenze für wichtige Seiten auf den meisten Sites. Tiefer braucht einen Grund. Eine Kategorie, die echt vier Ebenen in einer Hierarchie hat, kann auf Tiefe vier bleiben. Ein Blogpost, der vier Klicks tief liegt, weil Pagination ihn vergräbt, ist ein Problem.

Die Lösung ist direkte Verlinkung. Setzen Sie interne Links von reichweitenstarken Seiten, von kontextuell relevantem Inhalt oder aus der globalen Navigation. Ziel ist nicht, alles auf Tiefe eins zu drücken, das bricht Lesbarkeit. Ziel ist, dass keine wichtige Seite hinter unnötigen Klicks sitzt.

Praktische Visualisierung: ein SEO Crawler kann eine Linktiefen Verteilung für Ihre ganze Site erzeugen. Eine gesunde Verteilung hat die meisten Seiten zwischen Tiefe zwei und vier, einen kleinen Schwanz auf Tiefe fünf und mehr und null Seiten auf Tiefe sieben und mehr.

Interne Links im Maßstab auditieren

Manuelles Prüfen interner Links übersteht keine hundert Seiten. Auditieren ist ein Crawl Problem, kein Tabellen Problem.

Ein Desktop Crawler wie Seodisias durchläuft jeden internen Link Ihrer Site und produziert drei Ansichten, die für diese Arbeit zählen.

Anzahl eingehender Links pro URL. Für jede Seite, wie viele andere Seiten Ihrer Site darauf verlinken. Aufsteigend sortieren, um Waisen (null eingehend) und Fast Waisen (eins oder zwei eingehend) sichtbar zu machen. Absteigend sortieren, um zu prüfen, ob die Seiten mit den meisten eingehenden Links wirklich die sind, die Sie hervorheben wollen. Hat eine dünne Tag Seite hundert eingehende Links und Ihre Conversion Seite drei, ist das ein Strukturproblem.

Linktiefe. Für jede Seite, der kürzeste Pfad von der Startseite. Filtern auf Seiten in Tiefe vier und mehr. Für jede entscheiden, ob sie die Tiefe verdient oder einen kürzeren Pfad braucht.

Ankertext Aggregation. Für jede Ziel URL die Liste der Ankertexte, die darauf zeigen. Auf beschreibende Konsistenz achten. Seiten, deren Anker hauptsächlich “hier klicken” oder generisch sind, brauchen Aufmerksamkeit.

Derselbe Crawler fängt auch das technische Rauschen rund um interne Verlinkung ein, kaputte Links, die Weiterleitung oder Entfernung brauchen, Weiterleitungsketten, die Crawl Budget durch eigene Navigation aufzehren, und Seiten, die auf noindex Ziele verlinken.

Für Sites mit aktiver Redaktion: Audit monatlich. Für Sites in aktiver Migration oder nach großem Umbau: wöchentlich. Ziel ist nicht Perfektion, sondern Drift klein genug zu halten, dass kleine Korrekturen immer möglich sind.

Muster, die Wachstum überleben

Eine kleine Site verkabelt man von Hand. Eine Site mit fünftausend Seiten nicht. Muster, die Wachstum überleben, teilen drei Eigenschaften.

Sie sind systematisch. Die Platzierung interner Links wird vom Template entschieden, nicht von menschlicher Beurteilung. Ein Blogpost Template, das automatisch zur Eltern Kategorie, zu den letzten drei Beiträgen derselben Kategorie und zur Pillar Seite verlinkt, produziert konsistente Verlinkung ohne redaktionellen Aufwand.

Sie sind auditierbar. Das Muster produziert einen Linkgraphen, den ein SEO Crawler verifizieren kann. Soll das Template fünf Links setzen und der Crawler findet drei, ist das Template kaputt und braucht Untersuchung.

Sie tolerieren Drift. Redaktionsteams werden irgendwann auf Arten verlinken, die das Muster nicht vorgesehen hat. Das Muster muss diese Links absorbieren, ohne zu brechen. Ein Muster, das auf eine fixe Linkanzahl pro Seite setzt, bricht beim ersten kontextuellen Link im Body. Ein Muster, das sagt “jede Seite muss zur Eltern Kategorie verlinken”, nicht.

Die Kombination aus templatisierten Strukturlinks und redaktionellen Kontextlinks ist das, was die meisten Sites am Ende haben. Der strukturelle Teil wird vom CMS regiert. Der kontextuelle Teil von Autorinnen, die beschreibende Anker setzen und der Cluster Form folgen. Beide Teile sind dem Crawler sichtbar, beide tragen zur Crawl Budget Verteilung bei, beide brauchen periodische Audits.

Fazit

Interne Verlinkung sitzt am Schnittpunkt von Architektur, redaktioneller Praxis und Crawl Budget. Die Muster sind einzeln klein, sie summieren sich. Eine Startseite, die Pillar Seiten heraushebt, Cluster, die Stützinhalt verbinden, Anker, die Bedeutung tragen, Tiefe, die Priorität respektiert, und eine Audit Routine, die Drift fängt, diese fünf Elemente formen zusammen, wie jede Suchmaschine und jede KI Engine Ihre Site erlebt.

Für tiefere Abstimmung kombinieren Sie interne Link Audits mit Prüfungen zu Crawl Budget, E Commerce Crawl Budget und Ihrer SEO Crawler Routine. Der interne Linkgraph ist einer der vier oder fünf technischen SEO Hebel, die in jeder Site Größe zählen, und einer der wenigen, die auf bewusste Arbeit über Monate reagiert, nicht über Jahre.

Wenn Sie ein Werkzeug für den Crawl brauchen, laden Sie Seodisias herunter kostenlos. Es läuft lokal auf Ihrem Rechner, hat keine URL Obergrenzen und liefert eingehende Linkzahlen, Linktiefe und Ankertext Verteilungen als Teil jedes Audits.